Khi trí tuệ nhân tạo (AI) tiếp tục thâm nhập vào cuộc sống xã hội, sự thúc đẩy phát triển các hệ thống nhanh hơn và hiệu quả hơn thường làm lu mờ nhu cầu cấp bách về an toàn AI. Với thị trường AI được dự báo sẽ đạt 407 tỷ USD vào năm 2027 và tốc độ tăng trưởng hàng năm dự kiến là 37,3% từ năm 2023 đến năm 2030, việc ưu tiên lợi ích thương mại làm dấy lên những lo ngại đáng kể về an toàn và đạo đức trong phát triển AI.

Suy Giảm Niềm Tin Của Công Chúng

Việc tập trung không ngừng vào tốc độ và hiệu quả trong ngành công nghiệp AI đang làm suy giảm niềm tin của công chúng vào công nghệ AI. Có một khoảng cách lớn giữa tham vọng của ngành và những lo ngại của công chúng về rủi ro liên quan đến các hệ thống AI.

Khi AI trở nên gắn bó hơn trong cuộc sống hàng ngày, điều quan trọng là phải minh bạch về cách thức hoạt động của các hệ thống này và những rủi ro mà chúng có thể gây ra. Nếu thiếu sự minh bạch, niềm tin của công chúng sẽ tiếp tục suy giảm, cản trở việc chấp nhận rộng rãi và tích hợp an toàn AI vào xã hội.

Thiếu Minh Bạch và Trách Nhiệm

Động lực thương mại để phát triển và triển khai AI nhanh chóng thường dẫn đến thiếu minh bạch về cách thức hoạt động và rủi ro tiềm ẩn của các hệ thống này. Sự thiếu minh bạch này khiến việc quy trách nhiệm cho các nhà phát triển AI trở nên khó khăn và khó giải quyết các vấn đề mà AI có thể gây ra. Các quy trình rõ ràng và trách nhiệm giải trình là rất quan trọng để xây dựng niềm tin của công chúng và đảm bảo AI được phát triển một cách có trách nhiệm.

Lan Truyền Thành Kiến và Phân Biệt Đối Xử

Các hệ thống AI thường được đào tạo trên dữ liệu phản ánh các thành kiến xã hội, dẫn đến sự phân biệt đối xử đối với các nhóm thiểu số. Khi các hệ thống có thành kiến này được sử dụng, chúng tạo ra các kết quả không công bằng ảnh hưởng tiêu cực đến các cộng đồng cụ thể. Nếu thiếu sự giám sát và biện pháp khắc phục phù hợp, những vấn đề này sẽ trở nên tồi tệ hơn, nhấn mạnh tầm quan trọng của việc tập trung vào phát triển AI đạo đức và các biện pháp an toàn.

Tập Trung Quyền Lực và Tài Sản

Ngoài thành kiến và phân biệt đối xử, các tác động rộng lớn hơn của việc phát triển AI nhanh chóng cũng đáng lo ngại không kém. Sự phát triển không kiểm soát của các công cụ AI có nguy cơ tập trung quyền lực và tài sản khổng lồ vào tay một số ít các công ty và cá nhân. Sự tập trung này làm suy yếu các nguyên tắc dân chủ và có thể dẫn đến sự mất cân bằng quyền lực. Những người kiểm soát các hệ thống AI mạnh mẽ này có thể định hình các kết quả xã hội theo cách không phù hợp với lợi ích công cộng rộng lớn hơn.

Nguy Cơ Tồn Vong Từ Các Hệ Thống AI Không Được Định Hướng

Có lẽ hậu quả đáng báo động nhất của việc ưu tiên tốc độ hơn an toàn là khả năng phát triển các hệ thống AI “ngoài vòng kiểm soát”. AI ngoài vòng kiểm soát đề cập đến trí tuệ nhân tạo hoạt động theo cách không được mong đợi hoặc mong muốn bởi những người tạo ra nó, thường đưa ra các quyết định có hại hoặc trái ngược với lợi ích của con người.

Nếu không có các biện pháp an toàn thích hợp, các hệ thống này có thể gây ra mối đe dọa tồn vong cho nhân loại. Việc theo đuổi các khả năng AI mà không có các biện pháp an toàn vững chắc là một cuộc đánh cược với những hậu quả tiềm tàng thảm khốc.

Giải Quyết Các Mối Quan Ngại Về An Toàn AI Bằng Các Đánh Giá Phi Tập Trung

Các biện pháp an ninh và an toàn nội bộ có nguy cơ xung đột lợi ích, vì các nhóm có thể ưu tiên lợi ích của công ty và nhà đầu tư hơn lợi ích công cộng. Dựa vào các kiểm toán viên tập trung hoặc nội bộ có thể làm tổn hại đến quyền riêng tư và an ninh dữ liệu vì lợi ích thương mại.

Các đánh giá phi tập trung mang lại một giải pháp tiềm năng cho các mối lo ngại này. Trong một đánh giá phi tập trung, việc đánh giá và giám sát các hệ thống AI được phân bổ cho một cộng đồng đa dạng thay vì bị giới hạn trong một tổ chức duy nhất.

Bằng cách khuyến khích sự tham gia toàn cầu, các đánh giá này tận dụng kiến thức và chuyên môn tập thể, đảm bảo các đánh giá AI hệ thống mạnh mẽ và kỹ lưỡng hơn. Cách tiếp cận này phản ánh sự phát triển của các biện pháp an ninh trong thế giới tiền điện tử, nơi các cuộc thi kiểm toán và các đánh giá đám đông đã cải thiện đáng kể an ninh của các hợp đồng thông minh — các thỏa thuận kỹ thuật số tự thực thi.

An Toàn AI Trong Thế Giới Tiền Điện Tử

Sự giao thoa giữa AI và công nghệ blockchain đặt ra những thách thức an ninh độc đáo. Khi AI nổi lên như một phân ngành ngày càng phát triển trong ngành công nghiệp tiền điện tử, dự kiến sẽ đạt giá trị hơn 2,7 tỷ USD vào năm 2031, có nhu cầu cấp bách về các giao thức an toàn toàn diện cho AI và hợp đồng thông minh.

Để đối phó với những thách thức này, Hats Finance, một thị trường cạnh tranh kiểm tra lỗi và kiểm toán thông minh phi tập trung, đang triển khai một chương trình an toàn AI phi tập trung được thiết kế để dân chủ hóa quy trình đánh giá an toàn AI. Bằng cách dân chủ hóa an toàn AI thông qua các cuộc thi cộng đồng, Hats Finance nhằm tận dụng chuyên môn toàn cầu để đảm bảo các hệ thống AI vững chắc và an toàn.

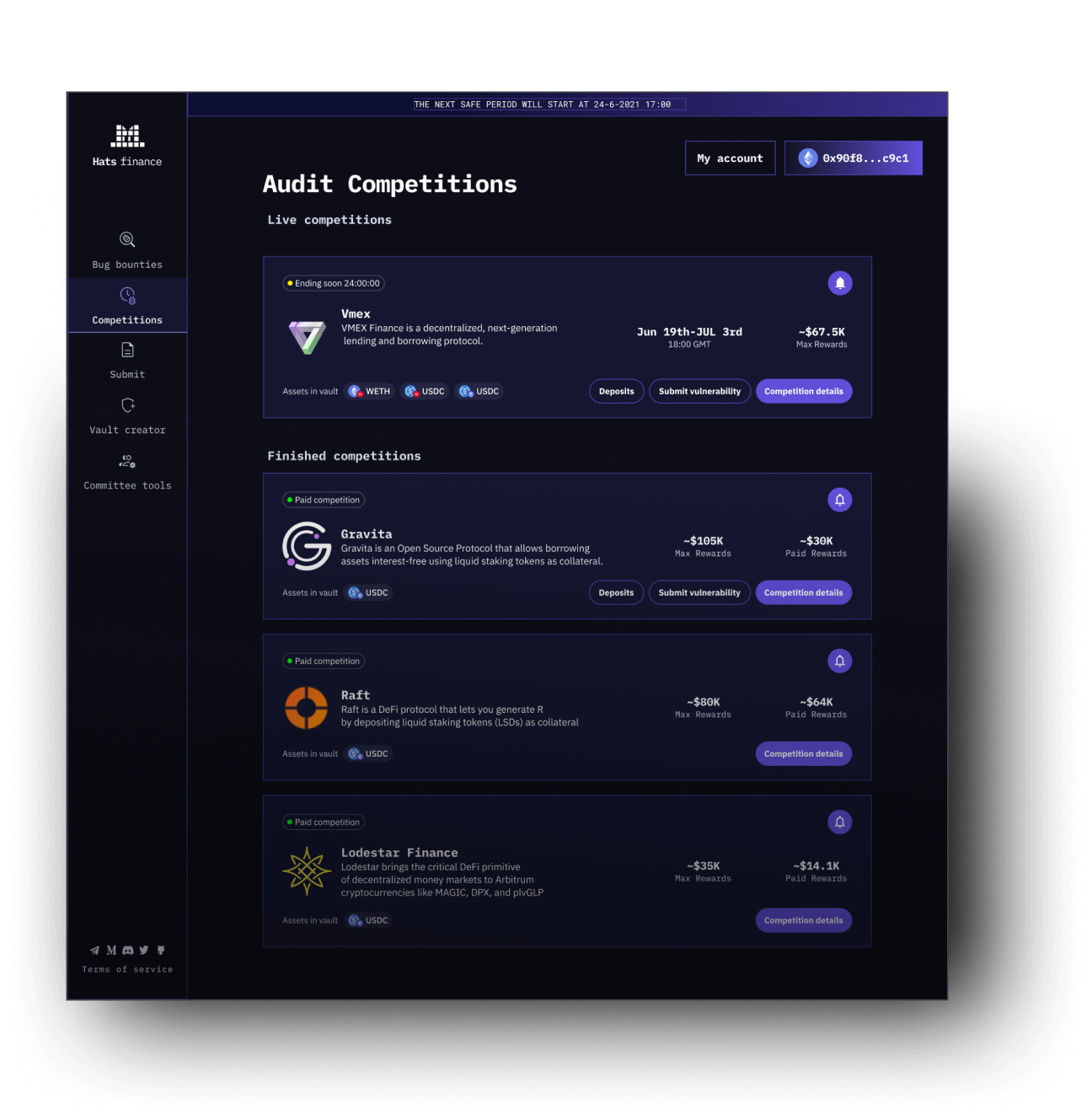

Các nhà nghiên cứu bảo mật Web3 có thể tham gia các cuộc thi kiểm toán để nhận phần thưởng. Nguồn: Hats Finance

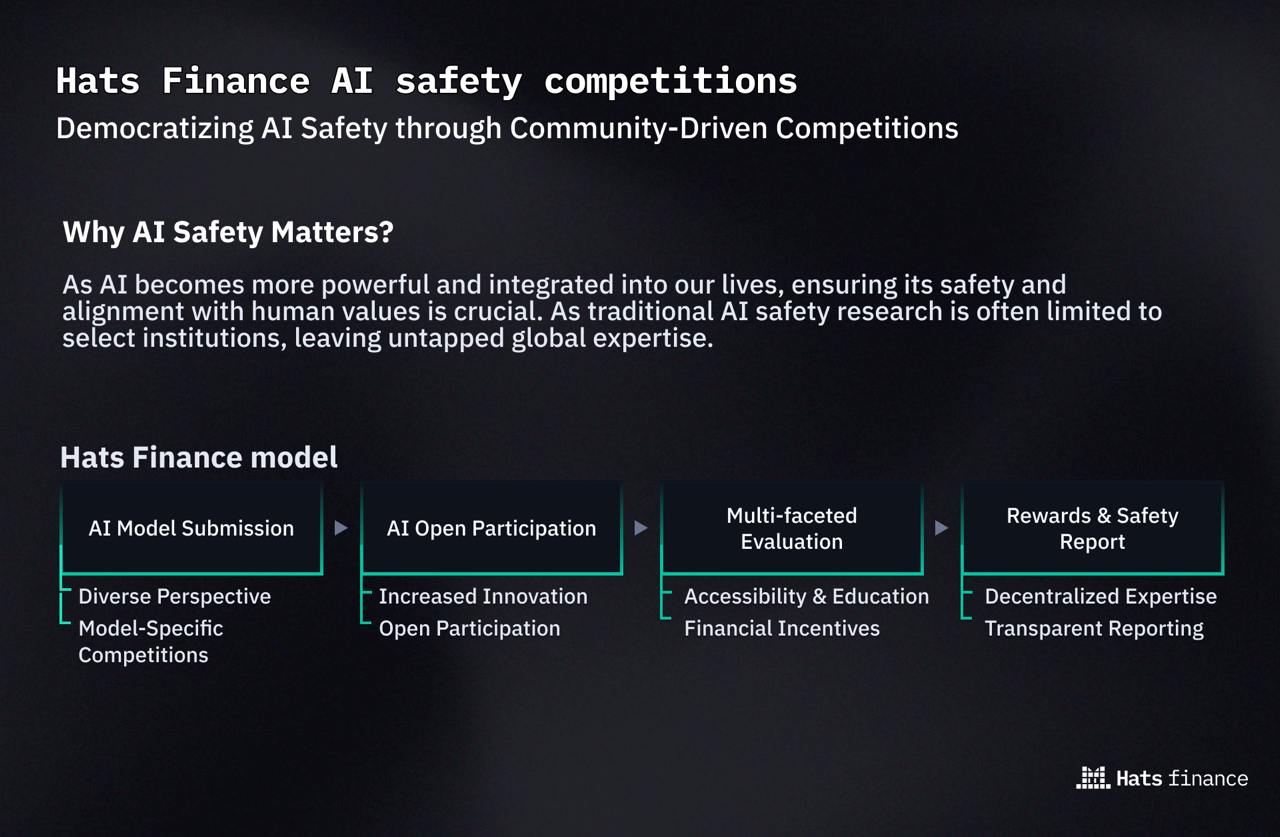

Nghiên cứu an toàn AI truyền thống thường bị giới hạn ở các tổ chức chọn lọc, bỏ lỡ một kho tàng chuyên môn toàn cầu. Hats Finance đề xuất một mô hình nơi an toàn AI không phải là trách nhiệm của một số ít mà là một nỗ lực tập thể.

Cách Hoạt Động Của Đánh Giá AI Phi Tập Trung

Bước đầu tiên trong quy trình của Hats Finance là các nhà phát triển gửi các mô hình AI. Các nhà phát triển này, từ các nhà nghiên cứu độc lập đến các tổ chức lớn, cung cấp các mô hình AI của họ để đánh giá. Bằng cách làm cho các mô hình này có sẵn để đánh giá, các nhà phát triển đang thực hiện một bước quan trọng hướng tới minh bạch và trách nhiệm giải trình.

Khi các mô hình AI được gửi, chúng sẽ bước vào giai đoạn tham gia mở. Trong giai đoạn này, một cộng đồng chuyên gia đa dạng từ khắp nơi trên thế giới được mời tham gia vào quá trình đánh giá. Tính toàn cầu của cộng đồng này đảm bảo rằng quá trình đánh giá được hưởng lợi từ nhiều quan điểm và chuyên môn khác nhau.

Tiếp theo, các mô hình AI trải qua các đánh giá đa dạng, nơi mỗi mô hình được đánh giá kỹ lưỡng bởi một nhóm chuyên gia đa dạng. Bằng cách kết hợp nhiều quan điểm và chuyên môn, quá trình đánh giá cung cấp một phân tích về điểm mạnh và điểm yếu của mô hình, xác định các vấn đề tiềm ẩn và các lĩnh vực cần cải thiện.

Sau khi đánh giá kỹ lưỡng, những người tham gia đóng góp vào quá trình đánh giá sẽ được thưởng. Các phần thưởng này đóng vai trò là động lực để các chuyên gia tham gia vào quá trình đánh giá và đóng góp những hiểu biết quý giá của họ.

Cuối cùng, một báo cáo an toàn toàn diện được tạo ra cho mỗi mô hình AI. Báo cáo này chi tiết các phát hiện của quá trình đánh giá, làm nổi bật bất kỳ vấn đề nào được xác định và đưa ra các khuyến nghị để cải thiện. Các nhà phát triển có thể sử dụng báo cáo này để tinh chỉnh các mô hình AI của họ, giải quyết bất kỳ mối quan ngại nào đã được nêu và nâng cao tính an toàn và độ tin cậy tổng thể của họ.

Nguồn: Hats Finance

Mô hình của Hats Finance dân chủ hóa quy trình và khuyến khích sự tham gia, đảm bảo các mô hình AI được xem xét kỹ lưỡng bởi một nhóm chuyên gia đa dạng.

Áp Dụng Cấu Trúc DAO Để Tăng Cường Minh Bạch

Hats Finance đang chuyển đổi thành một tổ chức tự trị phi tập trung (DAO) để phù hợp hơn với các mục tiêu của mình. DAO là một hệ thống mà các quyết định được đưa ra tập thể bởi các thành viên, đảm bảo tính minh bạch và quản trị chung. Sự thay đổi này, dự kiến sẽ xảy ra sau khi bán hồ bơi khởi động thanh khoản công khai và sự kiện tạo token của token gốc của Hats Finance, HAT, nhằm duy trì hệ sinh thái của các nhà nghiên cứu an ninh và thu hút tài năng toàn cầu cho các đánh giá an toàn AI.

Khi AI tiếp tục định hình thế giới, đảm bảo việc triển khai an toàn và đạo đức của nó trở nên ngày càng quan trọng. Cointelegraph Accelerator, Hats Finance, cung cấp một giải pháp đầy hứa hẹn bằng cách tận dụng các đánh giá phi tập trung, do cộng đồng điều khiển để giải quyết các mối lo ngại về an toàn AI. Bằng cách làm như vậy, nó dân chủ hóa quy trình và thúc đẩy một cảnh quan AI an toàn và đáng tin cậy hơn, phù hợp với mục tiêu rộng lớn hơn là tích hợp AI theo cách có lợi và an toàn cho tất cả mọi người.

Nguồn: Cointelegraph

Comments